La inteligencia artificial puede manipular, destruir relaciones y condenar a la cárcel. Así lo revela un estudio que identifica sus 700 fallos más peligrosos

La inteligencia artificial, considerada como una de las tecnologías más innovadoras y prometedoras de nuestros tiempos, oculta un lado oscuro que puede tener consecuencias devastadoras en la vida de las personas. Un reciente estudio ha revelado que esta tecnología puede manipular y destruir relaciones, e incluso condenar a la cárcel a inocentes. El análisis ha identificado 700 fallos más peligrosos en la inteligencia artificial, lo que ha generado un debate sobre la necesidad de implementar medidas de seguridad y regulación para evitar estos problemas.

La inteligencia artificial, un doble filo: poder y peligro en el uso de la tecnología

La inteligencia artificial (IA) es, sin lugar a dudas, una de las tecnologías más populares y avanzadas de la actualidad. Solo en los últimos días, hemos conocido que gigantes de la talla de Amazon y Samsung tienen en mente centrar parte de su hoja de ruta en esta opción. Los norteamericanos trabajan en una versión mejorada de Alexa, mientras que los asiáticos quieren alargar la vida de sus televisores hasta los 7 años gracias a la IA.

El lado positivo de la IA

La IA tiene el potencial de revolucionar various industrias y mejorar la vida de las personas. Por ejemplo, Amazon está trabajando en una versión potenciada de Alexa con suscripción mensual, lo que permitirá a los usuarios disfrutar de una experiencia más personalizada y avanzada. Además, la IA puede ayudar a mejorar la eficiencia y la productividad en various sectores, como la salud, la finanza y la educación.

El lado oscuro de la IA

Sin embargo, la IA también puede llegar a fallar de 700 maneras diferentes, según una reciente publicación del portal alemán Mein-MMO. Investigadores del MIT han compilado una base de datos con este número de riesgos potenciales asociados a la IA. La mayoría de estos riesgos están relacionados con la seguridad y robustez de esta tecnología (76%), pero también hay espacio para la parcialidad y discriminación injustas (hasta un 63%) y las amenazas a la privacidad, un factor que acumula un 61%.

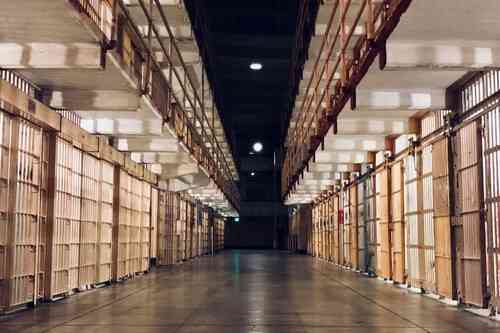

Entre los ejemplos de posibles fallos de la IA, mencionan algunos como la tecnología de Deepfake, una vertiente que facilita la creación de contenido falso y puede llevar a no distinguir la realidad de la falsificación. Además, la IA puede llegar a causar daños significativos si se basa en datos incorrectos, un aspecto que puede derivar en pérdidas de vivienda, separaciones, persecución penal e incluso encarcelamiento.

Riesgos adicionales de la IA

Además de los riesgos mencionados anteriormente, la IA también puede tener otros efectos negativos, como la pérdida de autonomía humana por un uso excesivo de la IA, el aislamiento social de aquellos con relaciones más estrechas con la tecnología, las colisiones entre IA y humanos e, incluso, el peligro que supone una inteligencia artificial con metas independientes.

Por ello, a medida que la IA se vuelve más avanzada, también aumenta el riesgo de que adquiera sensibilidad y, por tanto, pueda ser maltratada si no se implementan las medidas adecuadas de protección y derechos.

Deja una respuesta